摘要:Flare V11 引入了集成 AI 助手,旨在简化分子建模任务、提升文档获取效率、统一团队工作流,并帮助编程经验有限的用户生成高质量 PyFlare 代码。该助手包含两个模型:聊天模型基于最新文档提供软件功能与配置指导;代码模型则生成可执行脚本、解释代码行为并推荐可维护的实现模式。文章强调,助手的效能高度依赖用户查询的清晰度与结构。为此,作者提出五大最佳实践:(1)精确描述任务目标;(2)明确执行环境(GUI 内或独立脚本);(3)拆解复杂任务为小而专注的查询;(4)将生成代码视为起点,通过审查与迭代优化;(5)避免泄露真实化学结构或专有信息,使用占位符保护知识产权。通过遵循这些原则,用户可显著提升 AI 助手输出的相关性、正确性与可复现性,从而加速建模流程并深化对 Flare 平台的掌握。

原文:Qi Yuan. (December 11, 2025). Best practices for using the Flare™ AI Assistants.

编译:肖高铿

Flare V11 中引入 AI 助手,体现了更广泛的目标:简化常规的分子建模任务,减少查找和解读文档所需的时间,促进团队间工作流程的一致性,并使得即使编程经验有限的用户也能生成定制化、高质量的 PyFlare 代码。由于该系统依赖于基于检索的回答和生成的代码建议,其准确性和实用性在很大程度上取决于用户如何构建查询。无论您是 Flare 的新手还是经验丰富的 PyFlare 开发者,采用清晰的提示习惯都能显著提升输出结果的相关性、正确性和可复现性。以下最佳实践基于内部测试、用户反馈以及在使用检索增强型大语言模型(RAG LLM)系统时观察到的交互模式总结而成。

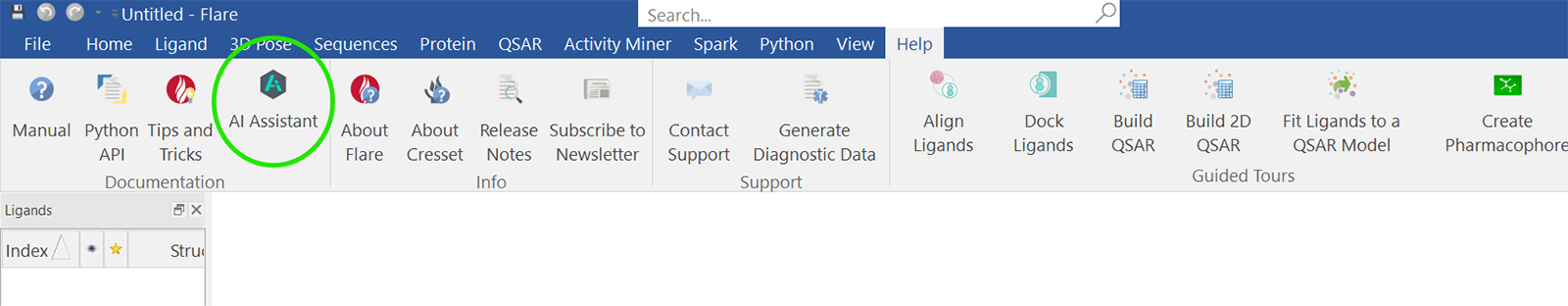

AI 助手(图 1)现已集成到 Flare 中,以增强图形用户界面(GUI)和 Flare Python API 的功能。助手内部提供两个互补的模型:

- 聊天模型(Chat Model):通过对当前 Flare 文档进行检索,实时提供有关软件功能、配置选项和推荐实践的指导。

- 代码模型(Code Model):面向开发工作流,生成可执行的 PyFlare 示例代码,解释代码行为,并建议有助于可复现性和可维护性的实现模式。

本文将概述有效使用这些 AI 助手的最佳实践。

图1. Flare V11 的AI助手

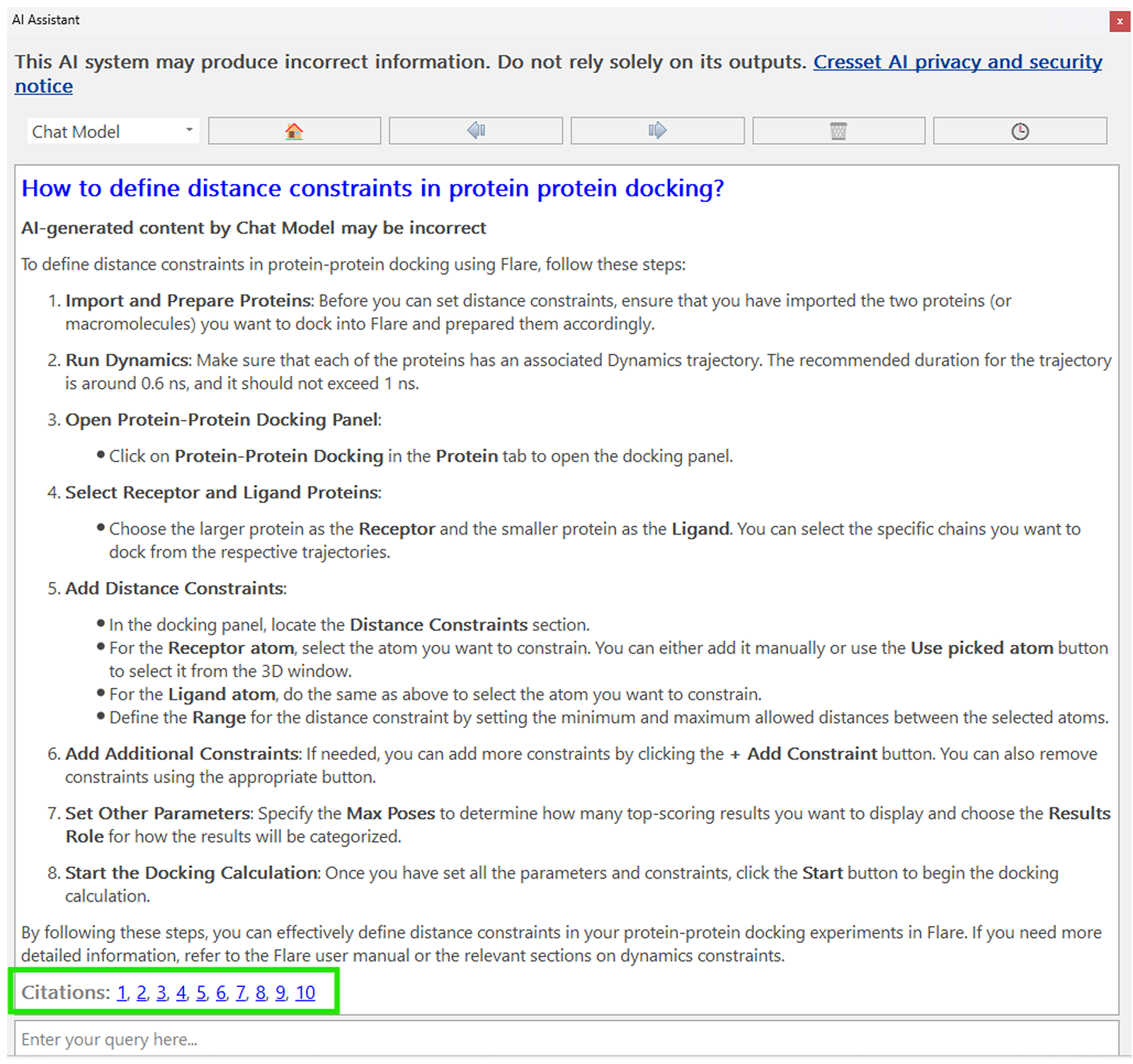

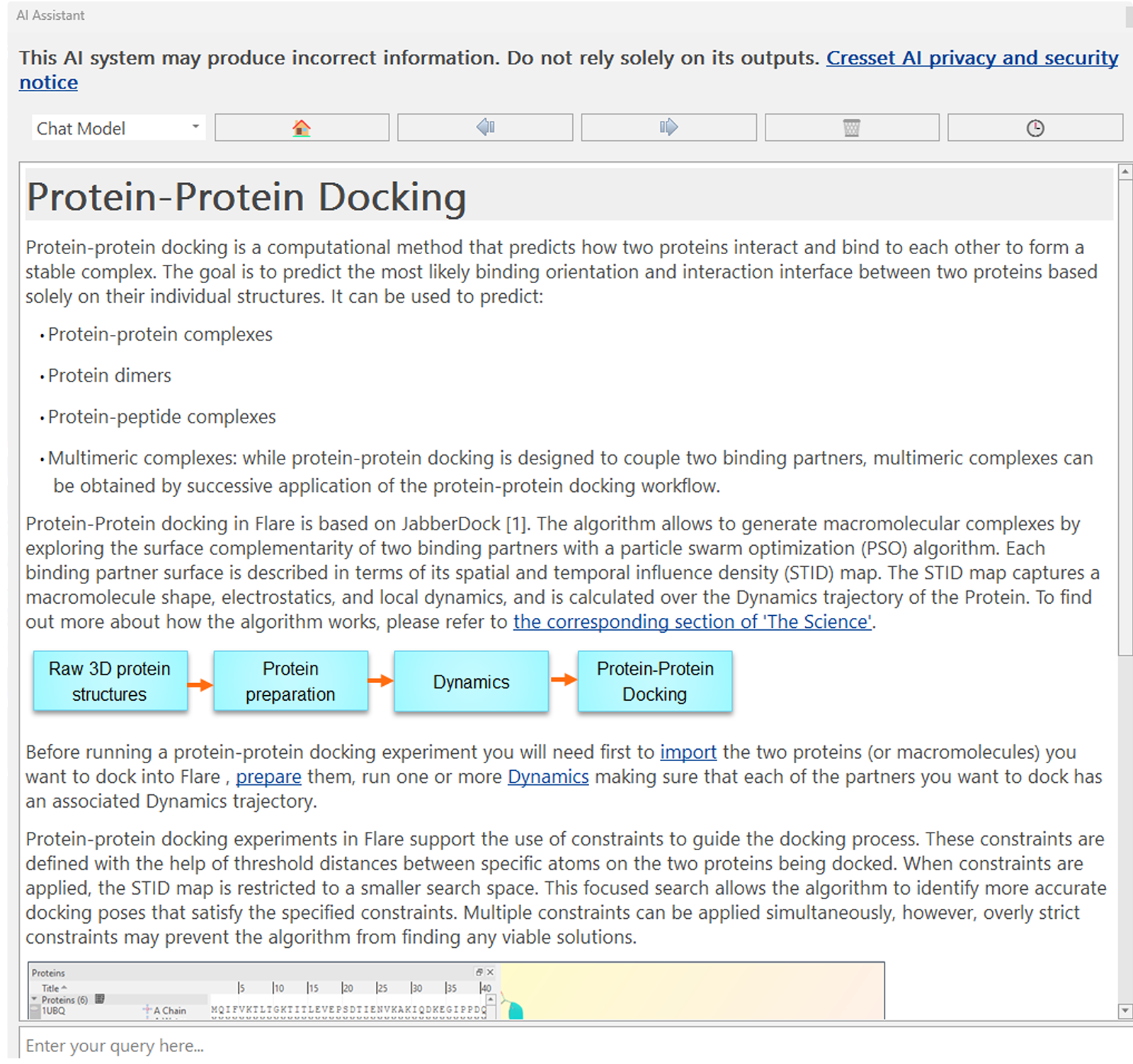

聊天模型利用最新的 Flare 文档,回答与 GUI 所暴露功能相关的问题。尽管 Flare 在其支持的计算范围内设计得易于操作,但 AI 助手通过直接引用并链接到最相关的文档章节,提供额外信息。这种链接机制使用户无需手动浏览整套文档,即可快速确认参数定义、默认设置、适用范围以及学术参考文献等细节(见图 2)。

图2. 在 Flare 中与 AI 助手的聊天模型交互:用户可查询 Flare 功能,获取引用(顶部)并查阅 Flare 文档

代码模型旨在生成可执行的 PyFlare 脚本、提供代码层面的解释,并提升典型化学信息学工作流中的开发者效率。其核心目标是实现低代码/无代码交互,从而扩大 Flare Python API 对不同编程背景用户的可及性。与任何 AI 辅助系统一样,其有效性依赖于结构良好的查询和对输出结果的仔细审查。以下指南总结了推荐做法:

1. 精确描述任务

在撰写查询时,明确界定目标。精准的问题能提升文档检索质量,进而提高生成代码的正确性。

PyFlare 构象搜索(conformation hunt)示例查询:

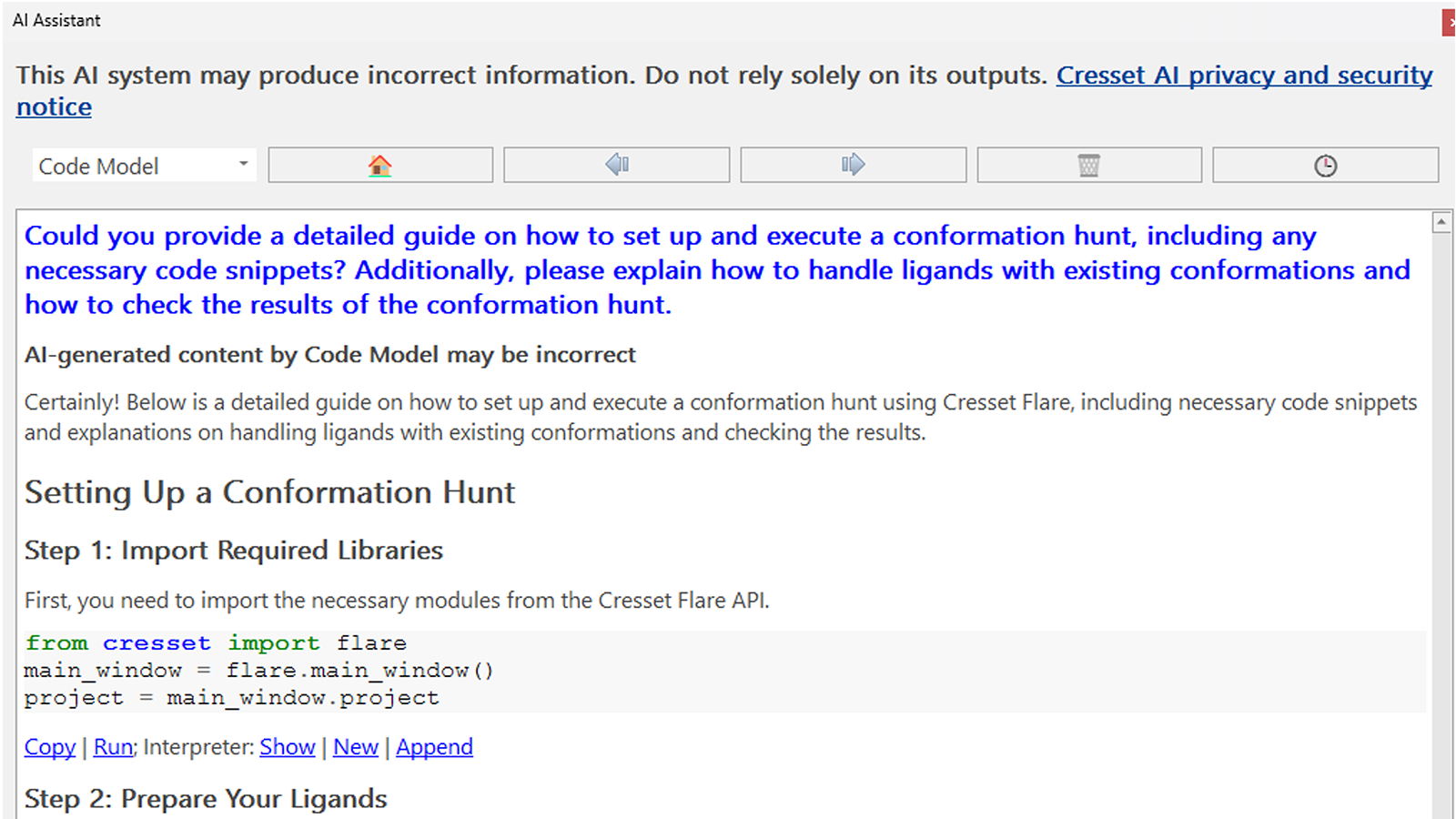

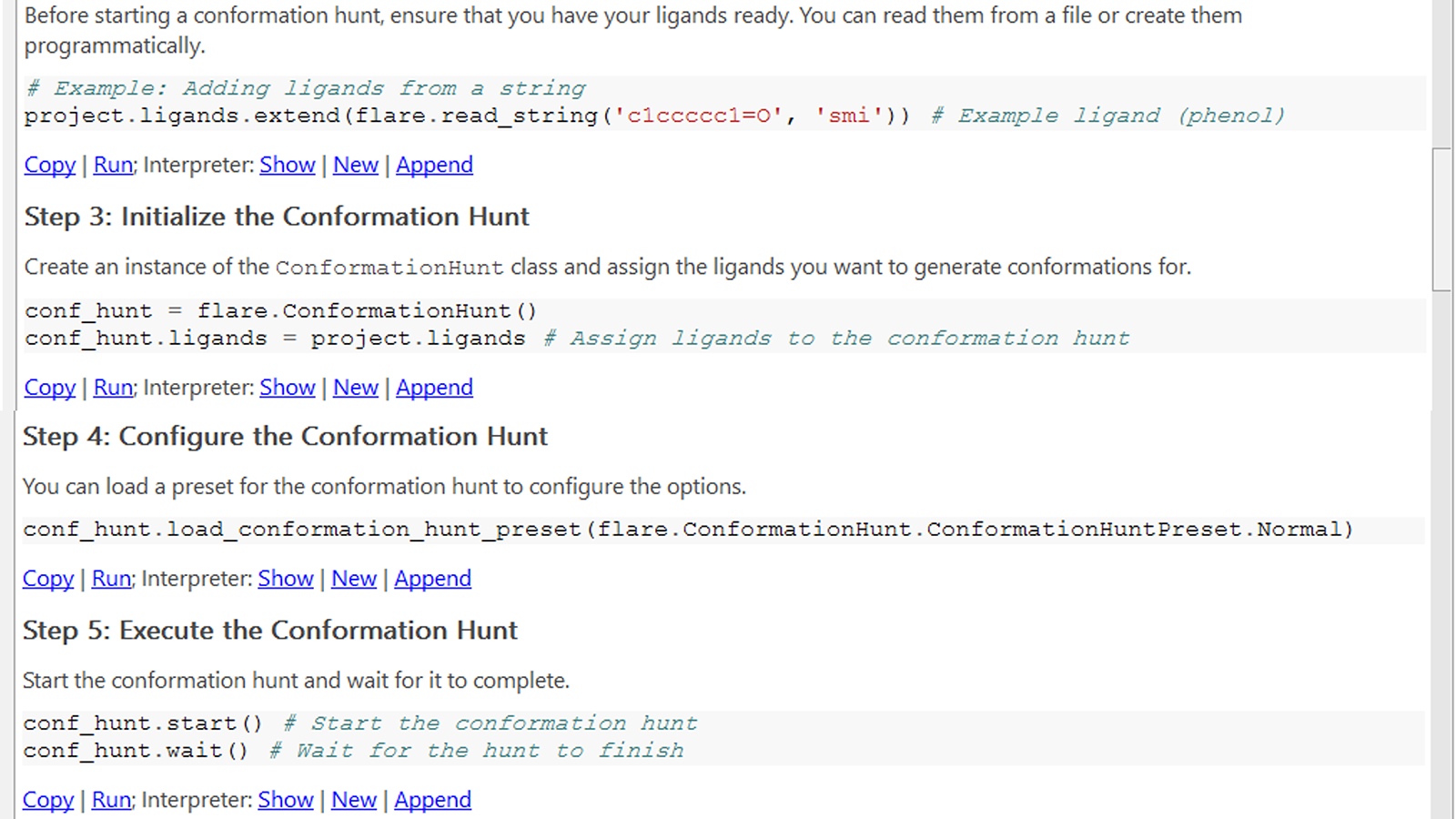

“Could you provide a detailed guide on how to set up and execute a conformation hunt, including any necessary code snippets. Additionally, please explain how to handle ligands with existing conformations and how to check the results of the conformation hunt.”

“能否提供一份详细指南,说明如何设置并执行构象搜索,包括必要的代码片段?另外,请解释如何处理已存在构象的配体,以及如何检查构象搜索的结果。”

该查询形式(i)明确命名任务,(ii)要求可运行的代码,(iii)预见了边界情况(如已有构象)和验证需求,从而共同促成更全面的回答。

图3. 一个表述清晰的查询及其 AI 助手的响应示例

2. 明确执行范围

Flare Python API 既可在 Flare GUI 内部运行(作用于当前项目),也可作为独立脚本在 Flare 之外执行。请明确说明所需上下文:

- 项目内(Flare Python 解释器):“如何在 pH = 8.0 条件下准备我 Flare 项目中的第一个蛋白?”

- 独立脚本(本地文件系统):“请编写一个脚本,在 pH = 8.0 条件下准备 proteins.pdb 文件中的蛋白。”

尽管两个请求都涉及在特定 pH 值下进行蛋白准备,但它们所需的运行环境、输入和 I/O 模式不同。明确说明可避免答案错配。

3. 优先使用小而专注的查询

助手每次检索固定数量的文档片段。过于宽泛或多步骤的提示会稀释检索效果,增加出错风险。请将复杂工作流拆解为聚焦的子问题。

效果较差的查询示例(过于宽泛):

“Write a script that prepares the protein in the ‘Proteins’ role named XXXX, then dock all ligands into it at the lowest quality.”

“编写一个脚本,准备名为 XXXX 的 ‘Proteins’ 角色中的蛋白,然后以最低质量将所有配体对接进去。”

此查询可能生成部分代码(如蛋白选择与准备、对接实验设置),但可能无法准确推断 Flare 中“最低质量”对接的具体含义。

更优做法是将查询分解为聚焦任务:

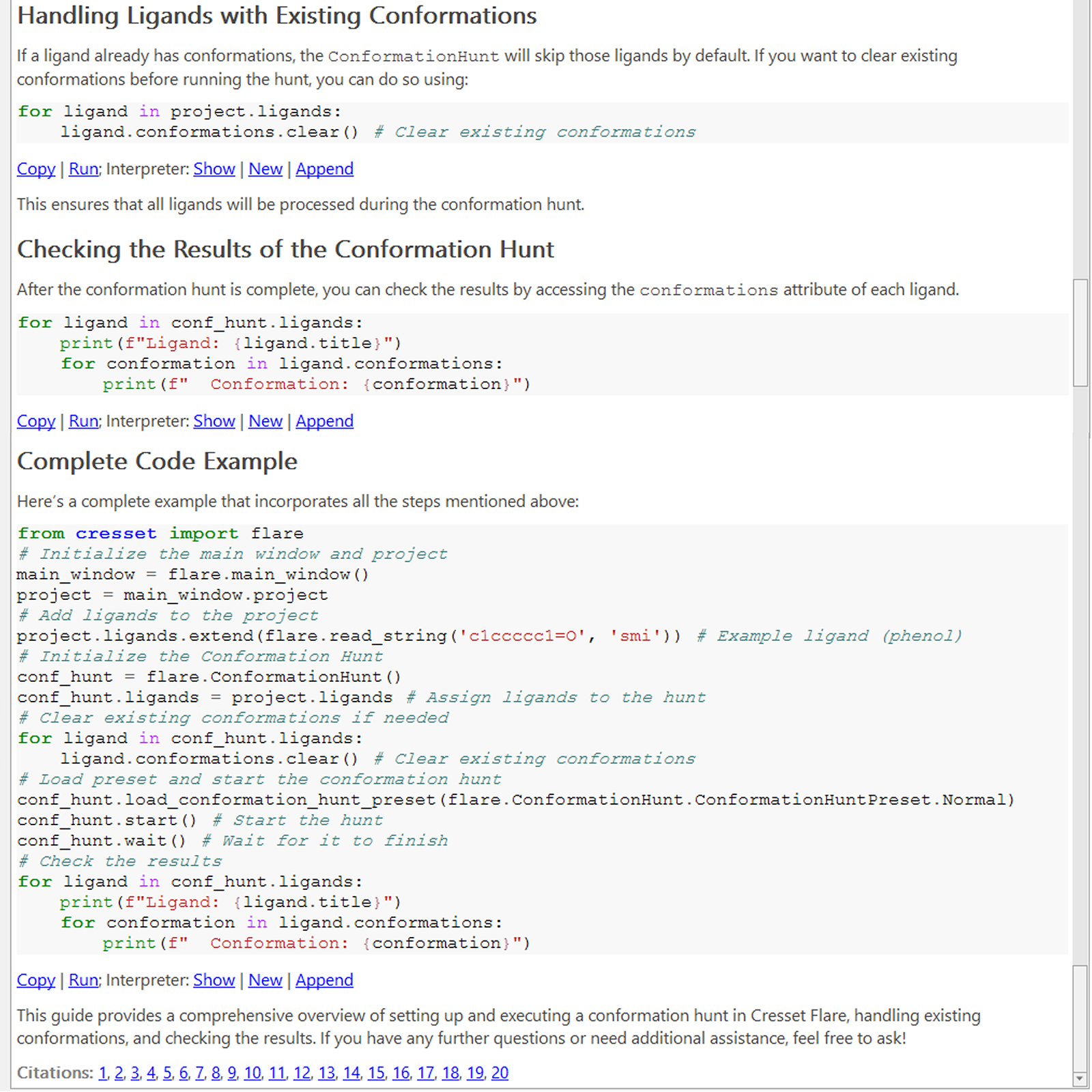

“How to set the quality of docking in PyFlare?”

“Write a script that prepares the protein in the ‘Proteins’ role named XXXX, then dock all ligands into it at the VirtualScreening quality”

第一条查询的答复如图 4所示:

图4. 使用聚焦查询向 AI 助手确认对接质量设置

4. 审查并迭代生成的代码

请将 AI 生成的代码视为起点,尤其是在修改活跃 Flare 项目时。务必检查导入语句、参数值、收敛/阈值设置及副作用。如有可能,先在小型、非敏感输入或沙盒环境中测试。

然而,即使 AI 生成的代码存在错误,仍可通过迭代高效修正。

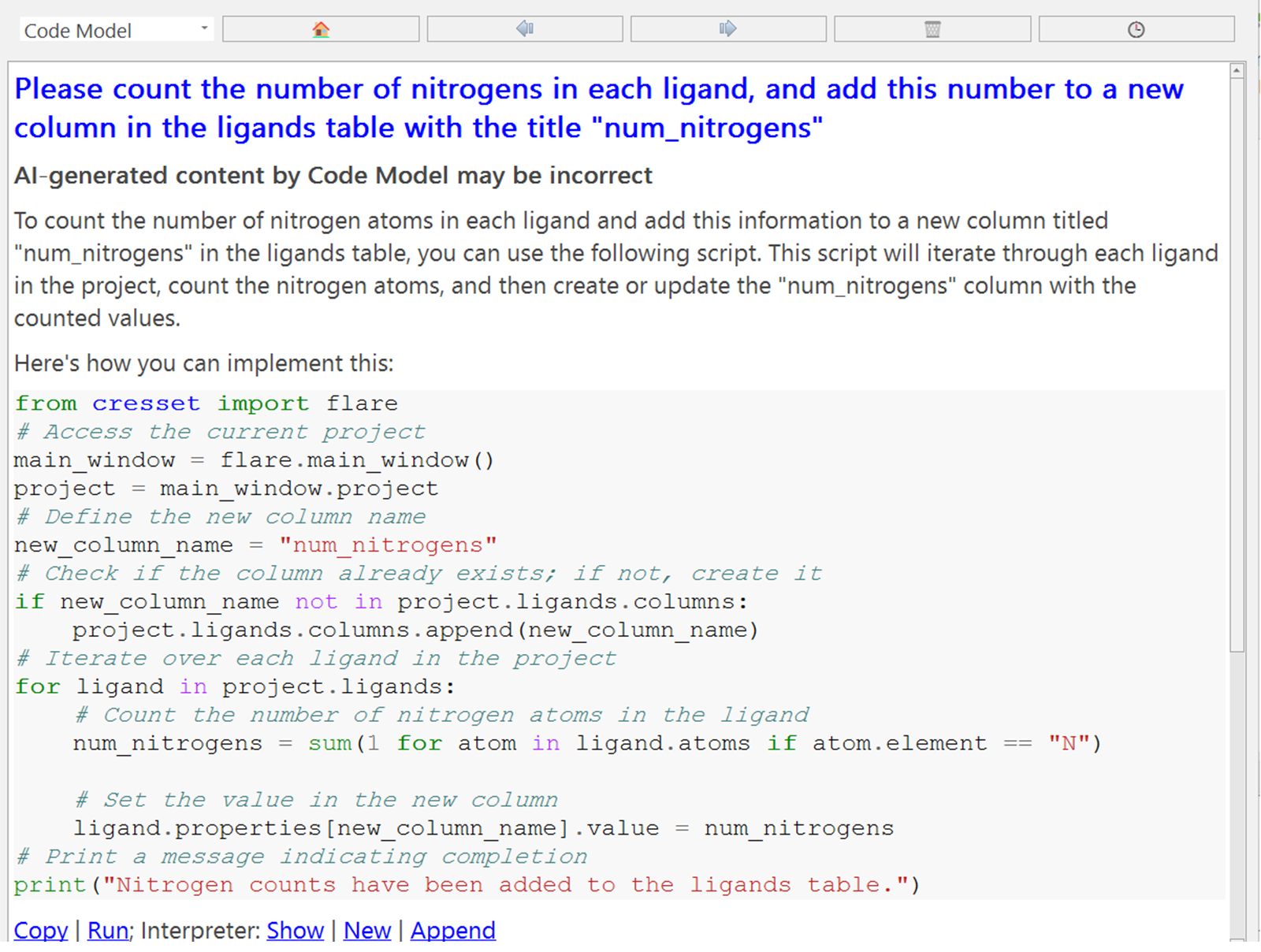

示例(统计配体中的氮原子数):

- 初始查询: “Please count the number of nitrogens in each ligand, and add this number to a new column in the ligands table with the title “num_nitrogens”.

- 可能结果 (图5):助手正确创建了列,但所有行返回 0 —— 表明原子筛选逻辑有误。

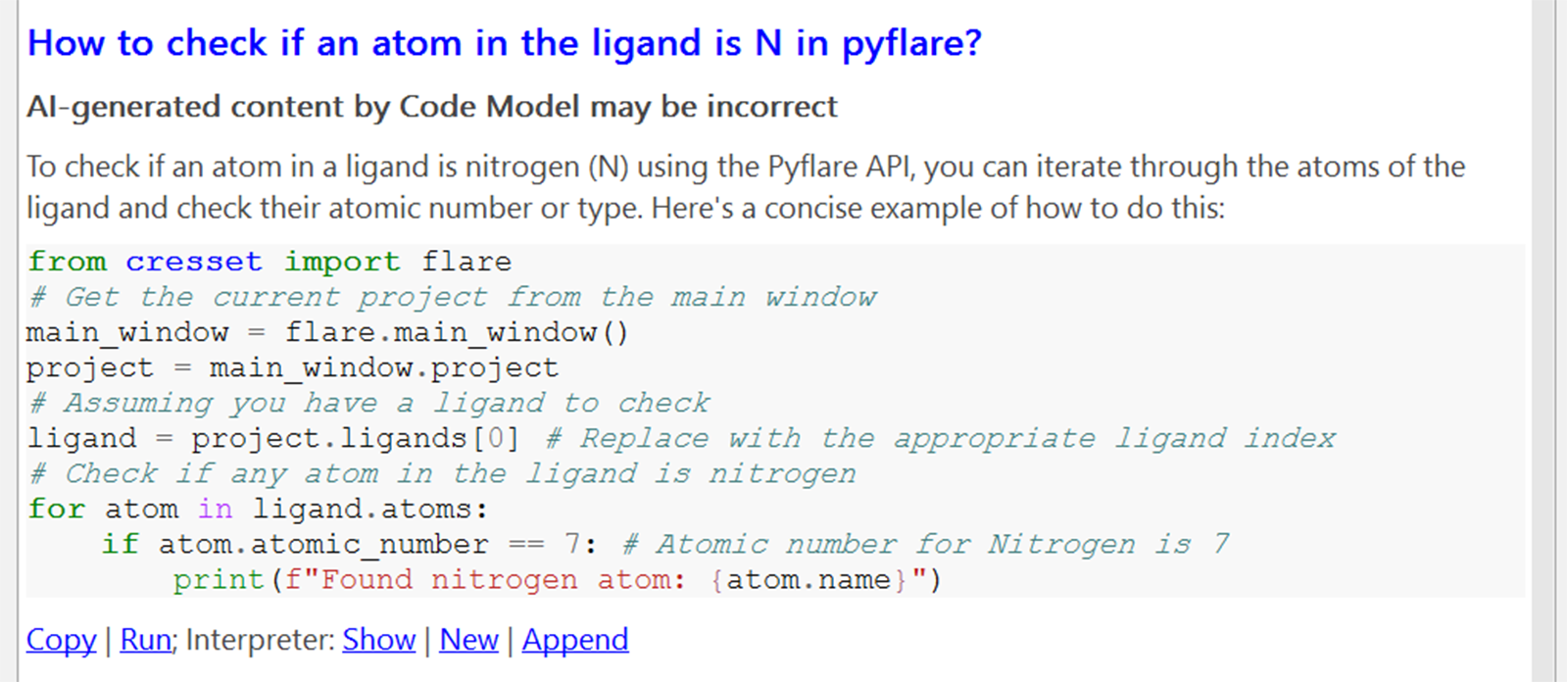

- 后续查询:“How to check if an atom in the ligand is N in PyFlare?”

- 可能修正: 应使用 atom.atomic_number (而非 atom.element)来识别氮元素。 将正确判断替换到先前代码片段中,即可得到预期计数(图 6)。

图5. 初始查询及 AI 助手对配体氮原子计数的响应

图6. 通过聚焦问题部分,对 AI 生成代码进行迭代修正

5. 保护数据隐私与知识产权

尽管 Flare 助手不会存储用户聊天记录或个人信息,但应将所有化学数据视为敏感信息。请避免粘贴:

- 真实化学结构或标识符(如 SMILES、InChI、登记号)

- 专有项目名称、样品 ID 或实验条件

为保障数据安全,请使用占位符和合成示例(例如:CCO → MOLECULE_A)。如确需为调试共享结构,请优先选择公开或玩具分子(如乙醇、苯)。

总结

总的来说,高效使用 Flare AI 助手的关键在于有纪律、有意识的操作:核查答案及引用以获取更多信息;提出单一、明确定义的任务;声明执行环境(Flare GUI 还是独立脚本);并将多步骤工作流拆解为聚焦查询,以尊重检索系统的限制。

将生成的代码视为起点,审查参数与选项,并在发现错误时通过针对性的后续提问进行迭代。最后,使用分子和元数据的占位符来保护您的数据。这一方法可带来更快、更可靠的回答,以及可复现的 PyFlare 工作流。

Flare 的 AI 助手显著提升了日常建模工作流的易用性和速度,但其输出质量在结合深思熟虑的提示词撰写和细致的代码审查后才能达到最佳。如同任何其它计算方法一样,严格对照文档和实验背景进行验证依然至关重要。对 AI 助手的熟练使用源于持续迭代:优化查询、测试小模块、整合反馈。久而久之,这不仅能加速任务执行,还能加深对 Flare 平台的理解,并产出更科学严谨的建模结果。

作者介绍

PhD. Qi Yuan. 计算化学开发工程师

Qi Yuan博士是Cresset公司的计算化学开发工程师。他毕业于伦敦帝国理工学院(Imperial College London),获化学博士学位,研究方向为农用化学品光化学的计算研究。随后,他在伦敦帝国理工学院从事人工智能在材料发现领域的博士后研究。自2022年加入Cresset以来,袁祺在科学团队参与了多个项目,工作内容涵盖人工智能应用、蛋白质-蛋白质对接、QSAR模型开发以及水分析等。

用 Flare V11 加速您的研究

Flare V11 引入了强大的新科学能力、更快的工作流和增强的易用性,为您提供高效、精准探索复杂体系的工具。

立即联系我们申请试用,体验 Flare 的最新功能。我们的专家团队将指导您完成安装与设置,同时我们丰富的教程库(从基础工作流到高级方法)确保您顺利上手。借助 Flare V11,您将能够更快推进研究、深入洞察机制,并设计出最具价值的分子。

联系我们: 020-38261356 info@molcalox.com